Notice

Recent Posts

Recent Comments

Gentle Breeze

[Hadoop] HDFS Checkpoint 본문

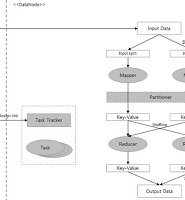

▲ Click to Enlarge ▲

① Secondary Namenode가 Namenode에게 Log File Rolling을 요청

② Namenode는 기존의 Edit Log File을 Rolling 한 후 새로운 Edit Log File을 생성

③ Secondary Namenode가 Rolling 된 Edit Log File과 FsImage를 다운로드 (HTTP GET)

④ Secondary Namenode는 FsImage File을 메모리에 올리고 Edit Log File에 있는 로그를 메모리에 Loading 된 FsImage에 적용, 메모리 갱신이 완료되면 새로운 FsImage File이 생성되고 이 File이 check pointing에 사용됨

⑤ Secondary Namenode는 check pointing 용 FsImage File을 Namenode에 전송 (HTTP POST)

⑥ Namenode는 기존 FsImage File을 check pointing 용 FsImage File로 변경하고 Edit Log 또한 2번에서 만들어진 파일로 변경

- 출처 : [BigData] 클라우드 컴퓨팅을 위한 하둡 (멀티캠퍼스 교재)

'⑨ 직무역량강화 > Bigdata' 카테고리의 다른 글

| [Hadoop] MapReduce, YARN (0) | 2015.01.19 |

|---|---|

| [Hadoop] Apache Hadoop Performance Tuning (0) | 2015.01.14 |

| [Hadoop] HDFS Default Block Size (0) | 2015.01.12 |

Comments